Einführung in Video Analyse und Regularien

Mit beschleunigter Entwicklung von KI-Systemen erweitern sich die technischen Möglichkeiten im Beriech Video Analyse (VA). Neben fortschreitenden Anwendungsfällen für betriebliche Effizienz und Sicherheit, verfolgt M2P die Gesetzeslage zur Gewährleistung von Datenschutz.

Zur Regulierung von KI-Systemen auf EU-Ebene führt das Europäische Parlament eine Debatte zur Umsetzung des Artificial Intelligence Act (AIA).

Aus gegeben Anlass beantworten wir Ihnen mit diesem Artikel die Fragen:

- Was ist der AIA?

- Wie wirkt sich der AIA auf Anwendungsfälle der Videoanalyse aus?

Dieser Artikel ist mit Fokus auf Grundlagen zu Gesetzen für Kamera SystemeVideo Analyse formuliert, Anwendungsfälle wie die der Medizin oder des Autonomen Fahrens werden ausgespart. Der Anspruch auf Vollständigkeit kann für einem Gesetzesentwurf in Abstimmung nicht erhoben werden.

Aktuelle Gesetzeslage für datenverarbeitende Systeme in der EU

Heute wird die Verarbeitung von personenbezogenen Daten in Video Analyse Systemen durch Kapitel II (Artikel 5 – 11), Datenschutz-Grundverordnung[7] (DSGVO) in der EU reguliert. Diese Vereinbarung wurde 2016 angenommen und ist im Mai 2018 in Kraft getreten. Hinreichende Vorgaben zur Regulierung von Technischen-, Ethischen-, Datenschutz-Risiken sowie Transparenzanforderungen an Künstliche Intelligenz sind in der DSGVO nicht gegeben.

Regulierung von KI Systemen durch neues Gesetz

Aus diesem Grund arbeitet die EU an einem neuen Gesetzesentwurf, dem Artificial Intelligence Act bzw. der „Vorschlag für eine Verordnung des Europäischen Parlaments und des Rates zur Festlegung harmonisierter Vorschriften für künstliche Intelligenz und zur Änderung bestimmter Rechtsakte der Union“ [1]. Dieser wurde in der ersten Lesung vor dem Europäischen Parlament am 14. Juni 2023 mit überwältigender Mehrheit (499 „Ja“-Stimmen, 93 Enthaltungen und 28 „Nein“-Stimmen) angenommen.[2]

Im Rahmen ihrer Digitalstrategie plant die EU, Artificial Intelligence (engl. Begriff für Künstliche Intelligenz, kurz KI) zu regulieren, um bessere Bedingungen für die Entwicklung und Nutzung dieser innovativen Technologie sicherzustellen. Es wird betont, dass KI „einen vielfältigen Nutzen für Wirtschaft und Gesellschaft über das gesamte Spektrum industrieller und gesellschaftlicher Aktivitäten hinweg hervorbringen [könne]“.[1]

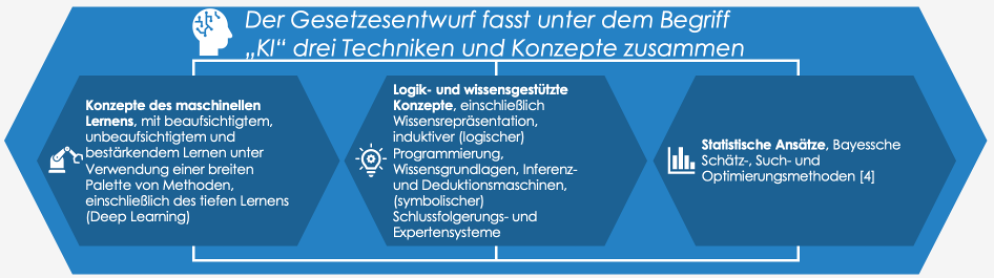

Verständnis des Europäischen Parlament von KI

Das Europäische Parlament definiert KI unter Verwendung von drei Konzepte. Die Definition in Anhang I des AIA[4] ist weit gefasst, sodass Systeme gestützt durch Konzepte des maschinellen Lernens, der Logik oder der Statistik dieser unterliegen, siehe Abbildung 1.

Das erklärte Ziel der EU ist es, dass KI-Systeme sicher, transparent, nachverfolgbar, diskriminierungsfrei und umweltfreundlich sind. Um schadhaften Resultaten vorzubeugen, sollen KI-Systeme von Menschen kontrolliert werden, anstatt vollautomatisch zu funktionieren.[3]

In der Praxis würde das Gesetz in seiner aktuellen Fassung beispielsweise die Verwendung von Gesichtserkennungssoftware einschränken.[2] Darüber hinaus sollen Systeme, die nicht als so gefährlich gelten, dass sie vollständig verboten werden, stärker reguliert werden. Die Betreiber von Anwendungen, wie OpenAI, Inc. (Betreiber von ChatGPT), müssten beispielsweise mehr Details über ihre Trainingsdaten offenlegen und die Textgenerierung in Bezug auf illegale Inhalte (stärker) einschränken.[6]

Geltungsbereich und Betroffene Akteure

Zur Achtung der Vorgaben unterscheidet der AIA zwischen Anbietern und Nutzern von KI-Systemen. Anbieter sind alle juristischen Personen, Behörden, Einrichtungen oder sonstige Stellen, die ein KI-System entwickeln oder entwickeln lassen. Die Regularien finden Anwendung, sobald die KI in der Union eingesetzt wird, auch wenn die Akteure in einem Drittland niedergelassen oder ansässig sind. [5]

Verschiedene Risikokategorien des Gesetzesentwurfs

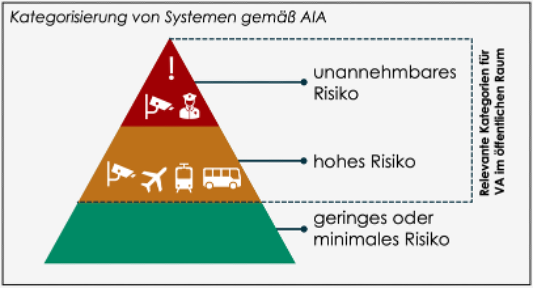

Des Weiteren kategorisiert der AIA, Systeme mit Anwendung von KI nach Risiko. Je nach Einstufung eines Systems unterscheiden sich die geltenden Regularien. In Abschnitt 5.2.2 sind die Stufen unannehmbares Risiko, hohes Risiko, Systeme mit geringem oder minimalem Risiko aufgelistet, vergleiche auch Abbildung 2. Für Kamera Systeme der TTL-Industrie (Travel, Transport, Logistic), die in kritischen Infrastrukturen wie Flughäfen eingesetzt werden, sind die beiden erstgenannten Kategorien relevant. Im Folgenden wird die Kategorisierung der Systeme mit unannehmbarem Risiko und hohem Risiko gegenübergestellt.

Gemäß Artikel 5[1] stellen KI-Systeme ein unannehmbares Risiko dar, deren Risiko als so hoch eingeschätzt werden, dass diese grundsätzlich verboten werden. Darunter fallen beispielsweise sogenannte „Social-Scoring-Systeme“. Auch der „Einsatz von biometrischen Echtzeit- Fernidentifizierungssystemen in öffentlich zugänglichen Räumen für die Zwecke der Strafverfolgung [soll] bis auf wenige Ausnahmen verboten werden.“[1] Ausnahmeregelungen können Anwendungen finden, wenn die Identifizierung erst mit erheblicher Verzögerung erfolgt, zur Verfolgung schwerer Straftaten dient und eine richterliche Genehmigung vorliegt.[3]

Gemäß Artikel 6[1] Anhang II & III[4] fallen Systeme in die Kategorie Hochrisiko-KI-Systeme, wenn die folgenden beiden Bedingungen erfüllt sind:

- KI-Systeme, die in Produkten verwendet werden, die unter die Produktsicherheit der EU fallen. Dazu gehören Produkte der Luftfahrt, Fahrzeuge, medizinische Geräte oder Aufzüge

- KI-System die in einer EU-Datenbank registriert werden müssen

Ausdrücklich werden in Anhang III des Gesetzesentwurfs die folgenden Anwendungen unter der Kategorie der Hochrisiko-KI-Systeme aufgeführt:

- Biometrische Identifizierung und Kategorisierung natürlicher Personen:

- KI-Systeme, die bestimmungsgemäß für die biometrische Echtzeit-Fernidentifizierung und nachträgliche biometrische Fernidentifizierung natürlicher Personen verwendet werden sollen;

- Verwaltung und Betrieb kritischer Infrastrukturen:

- KI-Systeme, die bestimmungsgemäß als Sicherheitskomponenten in der Verwaltung und im Betrieb des Straßenverkehrs sowie in der Wasser-, Gas-, Wärme- und Stromversorgung verwendet werden sollen; [4]

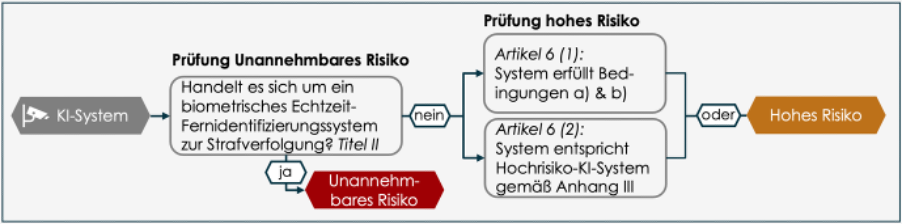

Einstufung eines KI Systems am Beispiel der Video Analyse

Anbei die schematische Darstellung zur Einstufung eines KI-Systems zur Video Analyse gemäß Gesetzesentwurf des AIA, siehe Abbildung 3. Zum Verständnis noch einige zitierte Begriffe aus dem AIA:

- Bei einer „biometrischen Fernidentifizierungssystem“ werden laut Artikel 3 (Begriffsbestimmungen) „natürliche Personen […] durch Abgleich der biometrischen Daten einer Person mit den in einer Referenzdatenbank gespeicherten biometrischen Daten […] identifiziert“.[1]

- „Strafverfolgung“ laut AIA nur durch Strafverfolgungsbehörden erfolgen

- Die Bedingungen in Artikel 6 (1) zur Klassifizierung als Hochrisikosystem lauten:

- Das KI-System soll als Sicherheitskomponente eines unter die in Anhang II aufgeführten Harmonisierungsrechtsvorschriften der Union fallenden Produkts verwendet werden oder ist selbst ein solches Produkt;

- Das Produkt, dessen Sicherheitskomponente das KI-System ist, oder das KI- System selbst als Produkt muss einer Konformitätsbewertung durch Dritte im Hinblick auf das Inverkehrbringen oder die Inbetriebnahme dieses Produkts gemäß den in Anhang II aufgeführten Harmonisierungsrechtsvorschriften der Union unterzogen werden.[1]

Fazit zu Video Analyse im neuen Gesetzesentwurf

Zusammenfassend kann aus dem aktuellen Gesetzesentwurf abgeleitet werden, dass der Einsatz von Video Analyse mit Künstlicher Intelligenz unter strengen Regularien grundsätzlich möglich bleibt. Da Systeme der Video Analyse von Unternehmen der TTL-Industrie hauptsächlich in öffentlich zugänglichen Räumen oder gar in Kritischen Infrastrukturen zum Einsatz kommen, sind diese mindestens als Systeme mit hohem Risiko einzustufen. Um zu gewährleisten, dass diese Systeme DSGVO und AIA konform bleiben, sind die Auflagen für Hochrisiko-KI-Systeme zu beachten.

Weiteres Vorgehen zum Abschluss des Gesetzesentwurf

Trotz erfolgreicher Abstimmung im Parlament ist das Gesetz noch lange nicht verabschiedet. In der EU müssen sogenannte Triloge zwischen Gesetzgebern, Kommissionsbeamten und Repräsentanten der Mitgliedsstaaten stattfinden. Es ist davon auszugehen, dass die derzeitige Version des AIA, die mit ihrem großzügig gefassten Anwendungsbereich auf viel Gegenwehr beispielsweise von großen Tech-Unternehmen trifft, vor ihrem endgültigen Beschluss noch (stark) abgeändert wird. Um zu Fragen rund um die Regulierung von KI in Kamerasystemen beraten zu können, wird M2P die Debatte im Europäischen Parlament verfolgen und daraus Konsequenzen für die Nutzung von Künstlicher Intelligenz in Kamera Systemen ableiten.

Speak to an expert

Quellen

[1] https://eur-lex.europa.eu/legal-content/DE/TXT/?uri=CELEX%3A52021PC0206 (01.10.2023)

[3] https://www.europarl.europa.eu/news/en/headlines/society/20230601STO93804/eu-ai-act-first-regulation-on-artificial-intelligence (10.10.2023)

[4] https://eur-lex.europa.eu/resource.html?uri=cellar:e0649735-a372-11eb-9585-01aa75ed71a1.0019.02/DOC_2&format=PDF (18.10.2023)

[5] https://eu-digitalstrategie.de/ai-act/ (20.10.2023)

[6] https://www.nytimes.com/2023/06/14/technology/europe-ai-regulation.html (20.10.2023)

[7] https://eur-lex.europa.eu/legal-content/DE/TXT/?uri=celex%3A32016R0679 (06.11.2023)